本地自部署大模型ollama

自己部署大模型ollama 实现无限量使用AI功能

通过Docker部署ollama

- 安装docker desktop桌面端,不会的可自行搜索教程

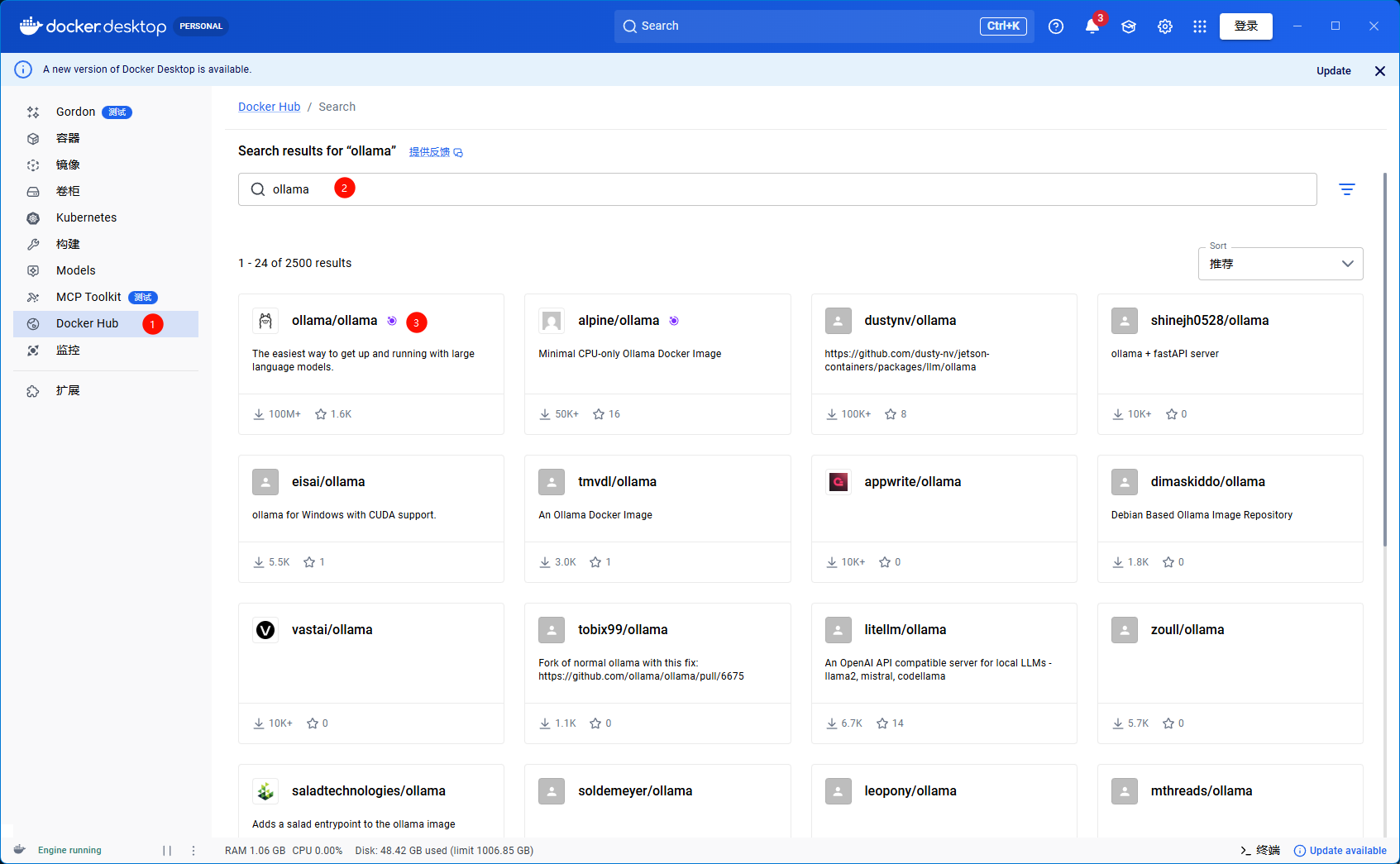

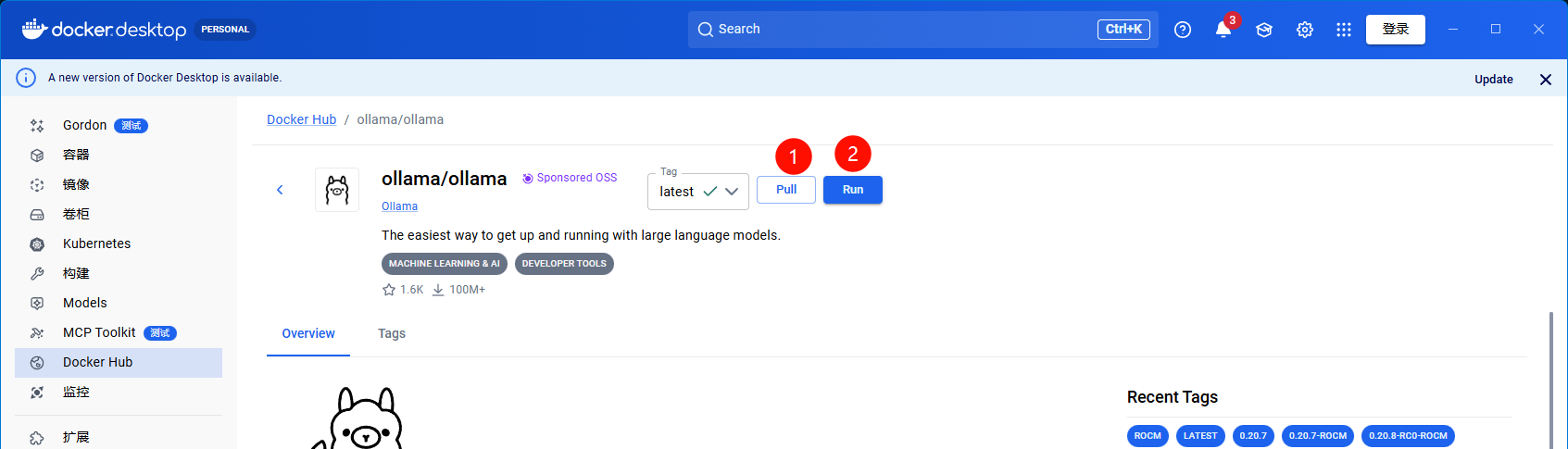

- 在Docker Hub 中搜索ollama 并下载运行镜像

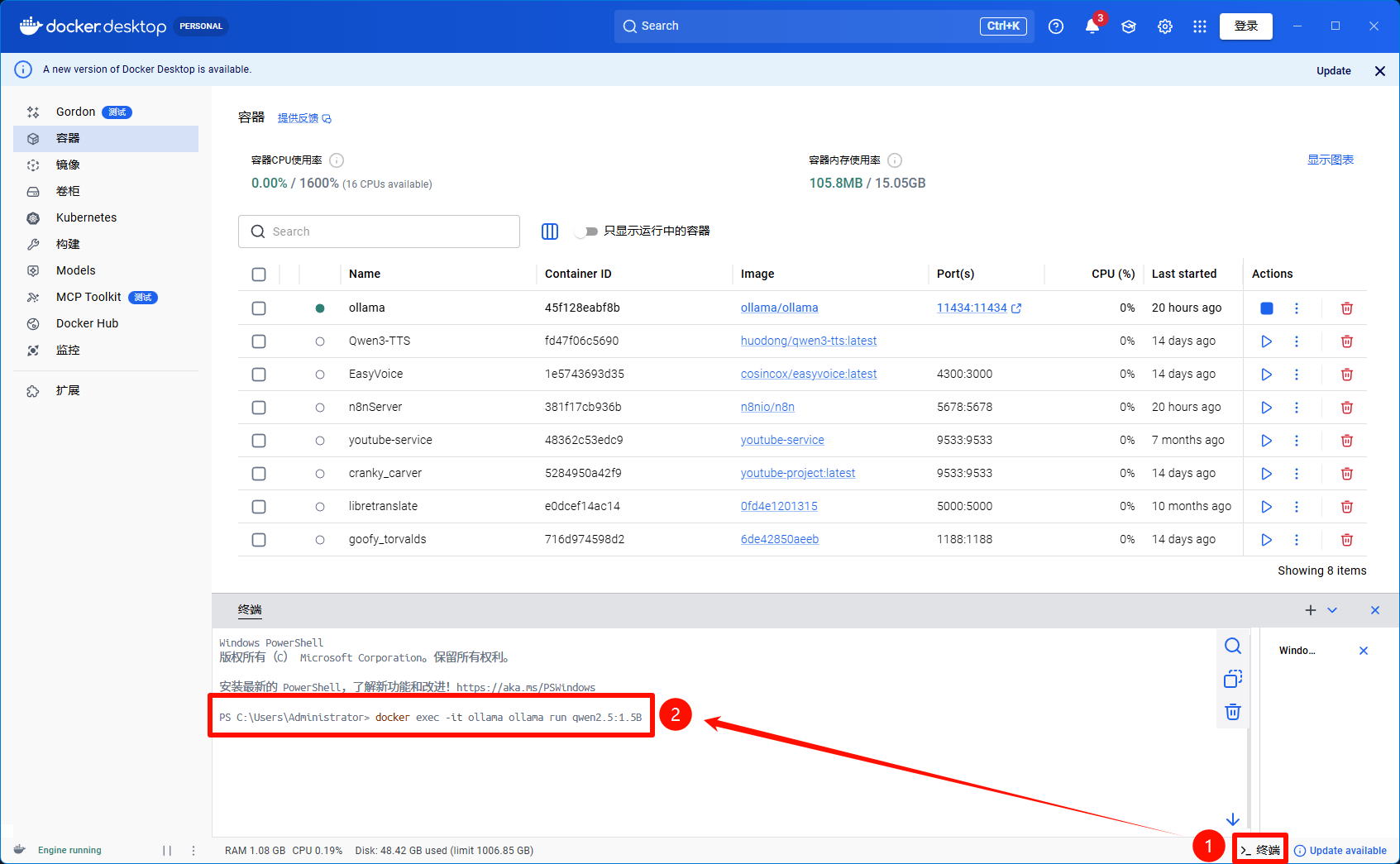

- 运行后通过终端运行以下代码,模型可以自己选择开源模型

# qwen2.5: 1.5b是模型名,你可以自行搜索或更改其他模型

docker exec -it ollama ollama run qwen2.5:1.5b

4.等待模型下载完成,需要允许插件跨域访问,从新运行以下命令

4.等待模型下载完成,需要允许插件跨域访问,从新运行以下命令

如果提示模型已经存在,请删除模型再重新运行命令

# 请从新在终端运行以下命令

docker run -d -v ollama:/root/.ollama -p 11434:11434 -e OLLAMA_ORIGINS="*" --name ollama ollama/ollama

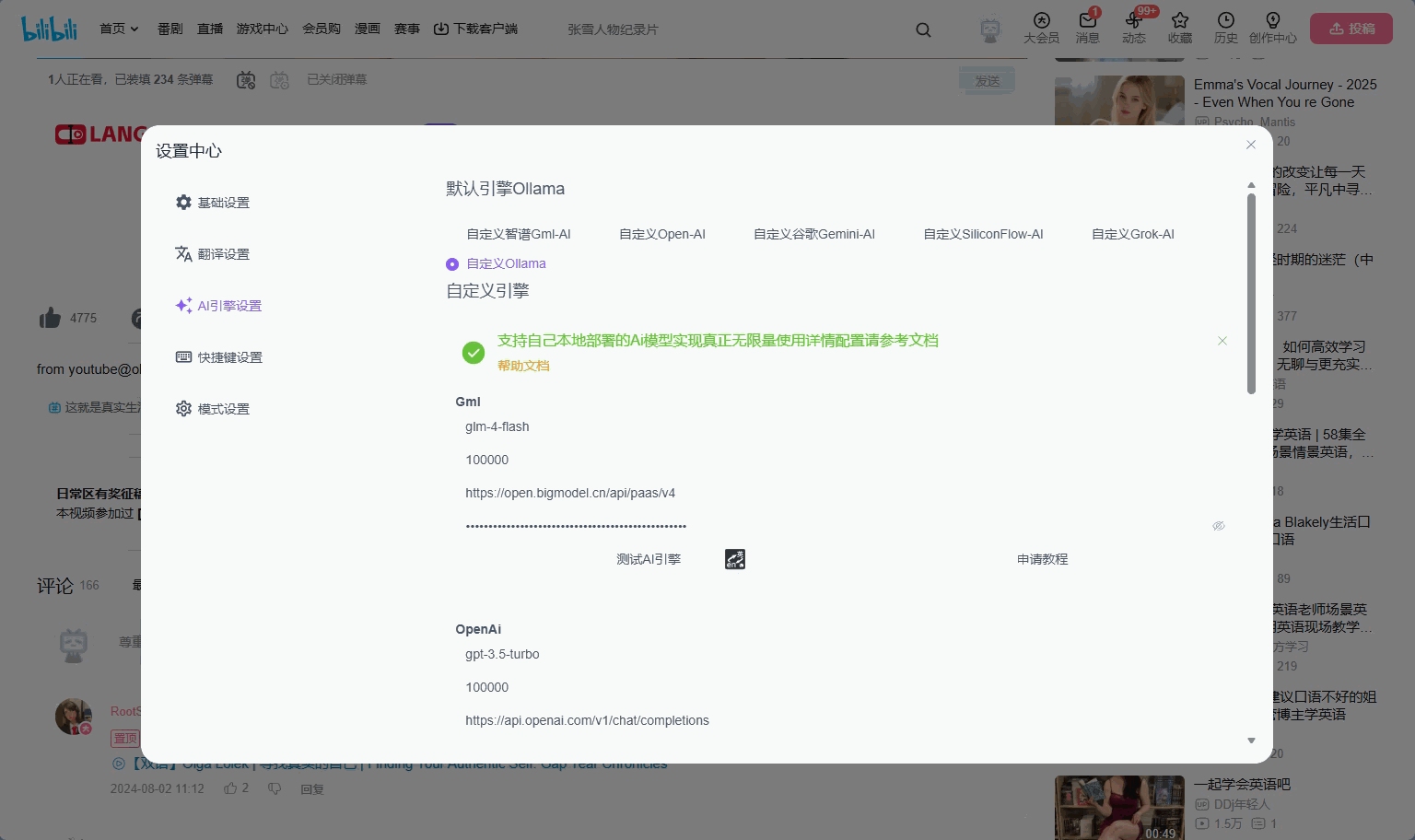

- 在插件的设置中测试ollama